Beyond One-on-One: Authoring, Simulating, and Testing Dynamic Human-AI Group Conversations

Google Research

Human-Computer Interaction and Visualization

Google Research

Human-Computer Interaction and Visualization

AI 生成摘要

Google Research 推出 DialogLab,一個用於撰寫、模擬和測試動態人機群組對話的研究原型,突破了與大型語言模型(LLMs)的一對一互動模式。

我們努力創造一個有利於跨多種不同時間尺度和風險等級進行多種類型研究的環境。

我們的研究人員透過基礎和應用研究推動電腦科學的進步。

我們定期與更廣泛的研究社群開放原始碼專案,並將我們的開發應用於 Google 產品。

發表我們的作品使我們能夠分享想法並協同工作,以推進電腦科學領域的發展。

我們向所有人提供產品、工具和數據集,目標是建立一個更具協作性的生態系統。

透過廣泛的程式設計來支持下一代研究人員。

透過與大學教師的有意義的互動參與學術研究社群。

透過活動與更廣泛的研究社群建立聯繫,對於在我們工作的各個方面取得進展至關重要。

2026 年 2 月 10 日

Erzhen Hu,學生研究員,以及 Ruofei Du,互動感知與圖形主管,Google XR

DialogLab 是一個研究原型,提供統一的介面來配置對話場景、定義代理角色、管理群組結構、指定輪流發言規則,以及協調腳本敘事和即興創作之間的轉換。

對話式人工智慧從根本上改變了我們與技術互動的方式。雖然與大型語言模型 (LLM) 的一對一互動取得了顯著進展,但它們很少能捕捉到人類溝通的完整複雜性。許多現實世界的對話,包括團隊會議、家庭晚餐或課堂課程,本質上都是多方的。這些互動涉及流暢的輪流發言、角色轉變和動態中斷。

對於設計師和開發人員來說,模擬自然且引人入勝的多方對話歷來需要權衡:接受腳本互動的僵化,或接受純粹生成模型的不可預測性。為了彌合這一差距,我們需要將腳本的結構可預測性與人類對話的自發、即興性質相結合的工具。

為了滿足這一需求,我們推出了 DialogLab,該工具已在 ACM UIST 2025 上展示,它是一個開放原始碼原型框架,旨在創作、模擬和測試動態人機群組對話。DialogLab 提供了一個統一的介面來管理多方對話的複雜性,處理從定義代理角色到協調複雜的輪流發言動態的所有事情。透過將即時即興創作與結構化腳本整合,此框架使開發人員能夠測試從結構化的問答環節到自由流動的創意腦力激盪的各種對話。我們與 14 位最終用戶或領域專家的評估驗證了 DialogLab 支持高效迭代以及用於培訓和研究的逼真、適應性強的多方設計。

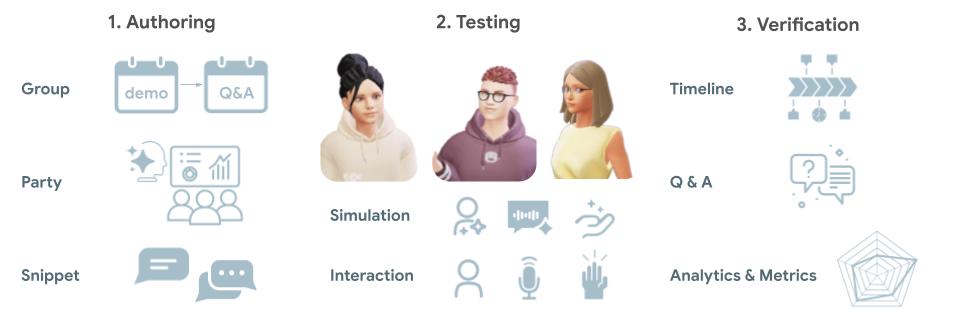

DialogLab 是一個研究原型,支持創作、模擬和測試動態人機群組對話。設計師可以 1) 配置群組、參與者、片段特徵,2) 透過模擬和即時互動進行測試,以及 3) 透過時間軸視圖和事後分析獲得見解。

DialogLab 將對話的社交設置(例如參與者、角色、子群組和關係)與其時間進程分開。這種分離使創作者能夠透過簡化的三階段工作流程來創作複雜的動態:創作、測試、驗證。

DialogLab 框架的核心是沿兩個維度定義對話:

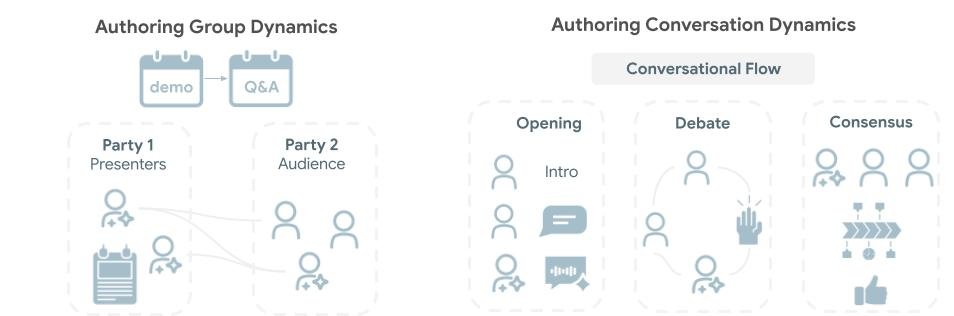

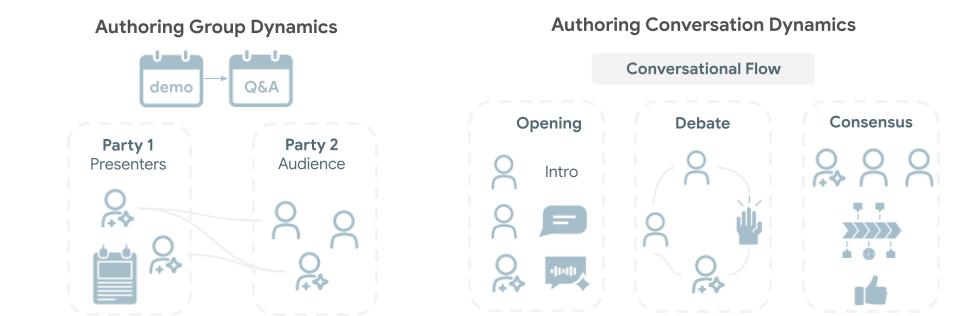

我們的框架將社交設置(角色、參與者)與時間流程(片段、輪流發言規則)分開,從而實現模組化對話設計。左:演示者和問答聽眾的創作群組動態範例;右:創作三個階段的對話動態範例:開場、辯論、共識。

DialogLab 透過結構化的創作-測試-驗證工作流程引導創作者,並由專為快速迭代而設計的可視化介面提供支持。

DialogLab 原型的演示,該原型支持動態人機群組對話的創作、模擬和測試。

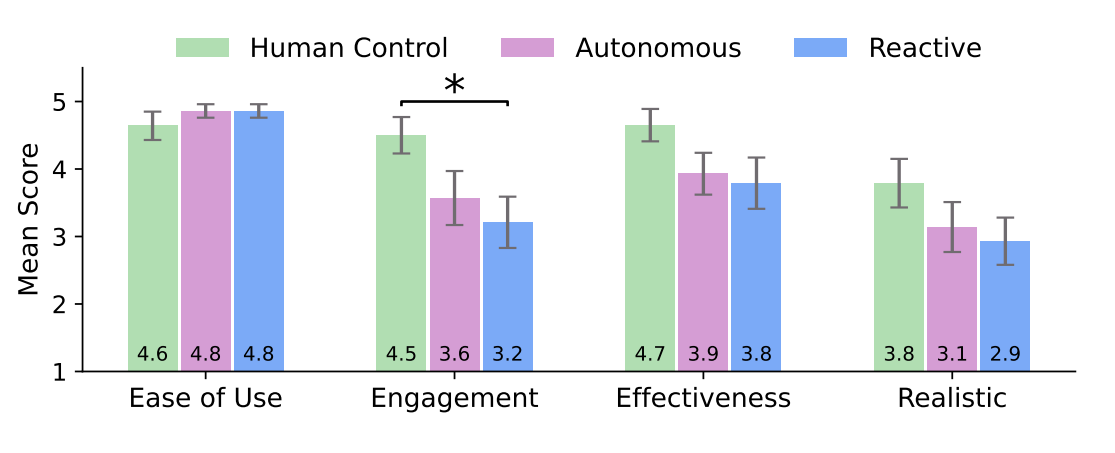

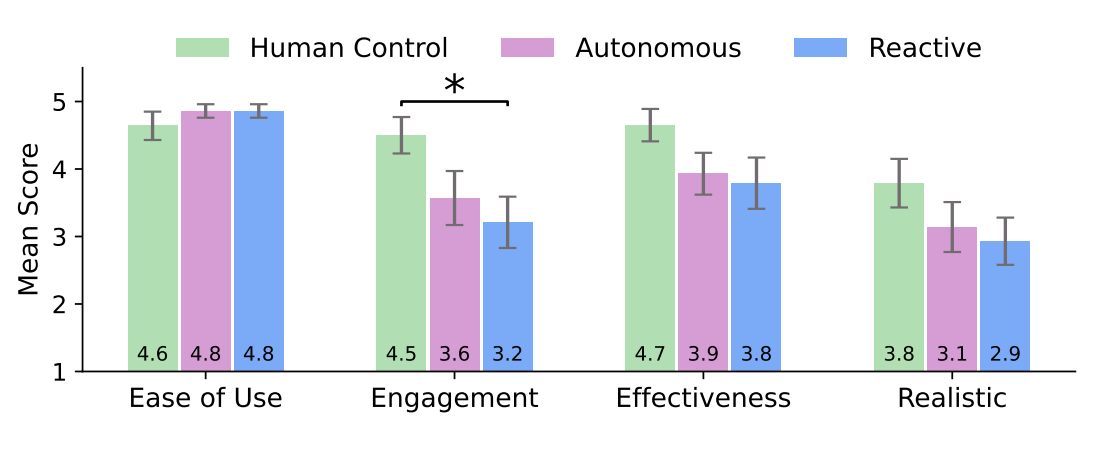

我們與來自遊戲設計、教育和社會科學研究的 14 位參與者一起評估了 DialogLab。參與者在 DialogLab 中完成了兩項任務:設計一個學術社交活動,以及在三種條件下測試與人工智慧的群組討論:

參與者以 5 點李克特量表對每種條件進行評分。參與者發現人工控制模式更具吸引力,並且通常對於模擬現實世界的對話更有效且更逼真。

比較人工控制、自主和反應式系統在易用性、參與度、有效性和真實性方面的條形圖。

參與者的回饋進一步突顯了系統在自動化與控制之間取得平衡的能力:

DialogLab 不僅僅是一個研究原型;它是朝著人機協作更加豐富和細緻的未來邁出的一步。潛在的應用非常廣泛:

DialogLab 的應用範例,包括練習會議問答環節、模擬辯論和創建遊戲對話設計。

展望未來,我們設想更豐富的多模式行為,例如非語言手勢和面部表情,可以整合到此框架中。我們還可以探索使用逼真的頭像和 3D 環境(如 ChatDirector)在我們的開放原始碼 XR Blocks 框架中創建更具沉浸感和逼真的模擬。我們希望這項研究能夠激發在令人興奮且新興的人機群組對話動態領域中持續創新。

觀看 DialogLab 的影片演示以了解更多資訊。

該專案的主要貢獻者包括 Erzhen Hu、Yanhe Chen、Mingyi Li、Vrushank Phadnis、Pingmei Xu、Xun Qian、Alex Olwal、David Kim、Seongkook Heo 和 Ruofei Du。我們要感謝 Adarsh Kowdle 為手稿和部落格文章提供回饋或協助。該專案部分由 Google 博士獎學金贊助。

2026 年 2 月 5 日

2026 年 2 月 3 日

2026 年 1 月 28 日

追蹤我們