領先的推論供應商透過 NVIDIA Blackwell 上的開源模型將 AI 成本降低高達 10 倍 | NVIDIA 部落格

NVIDIA 的人工智慧運算領導地位

領先的推論供應商透過 NVIDIA Blackwell 上的開源模型將 AI 成本降低高達 10 倍

醫療保健中的診斷洞察力。互動遊戲中角色的對話。客戶服務專員的自主解決方案。這些由 AI 驅動的互動都建立在相同的智慧單元上:一個 token。

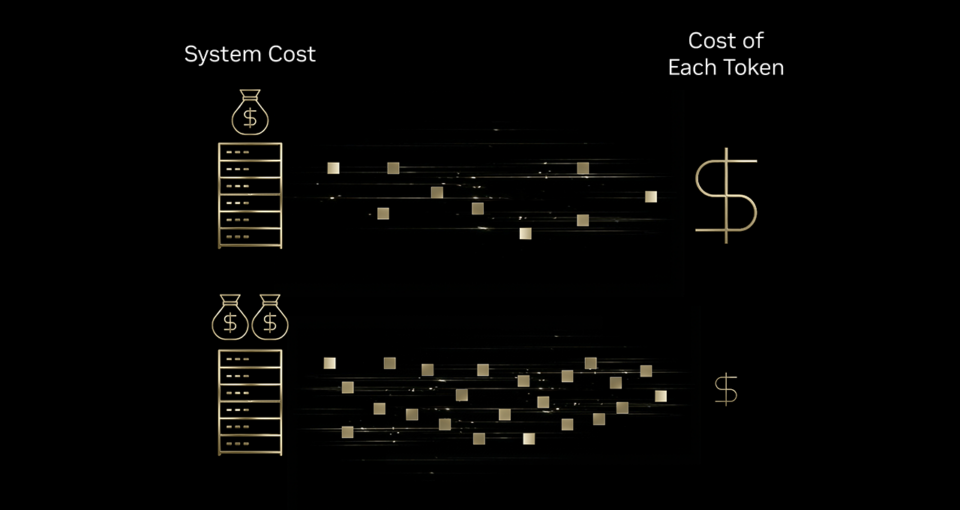

擴展這些 AI 互動需要企業考慮他們是否能負擔更多的 token。答案在於更好的 tokenomics — 其核心是降低每個 token 的成本。這種下降趨勢正在各個行業展開。麻省理工學院最近的研究發現,基礎設施和演算法效率每年將前沿級別效能的推論成本降低高達 10 倍。

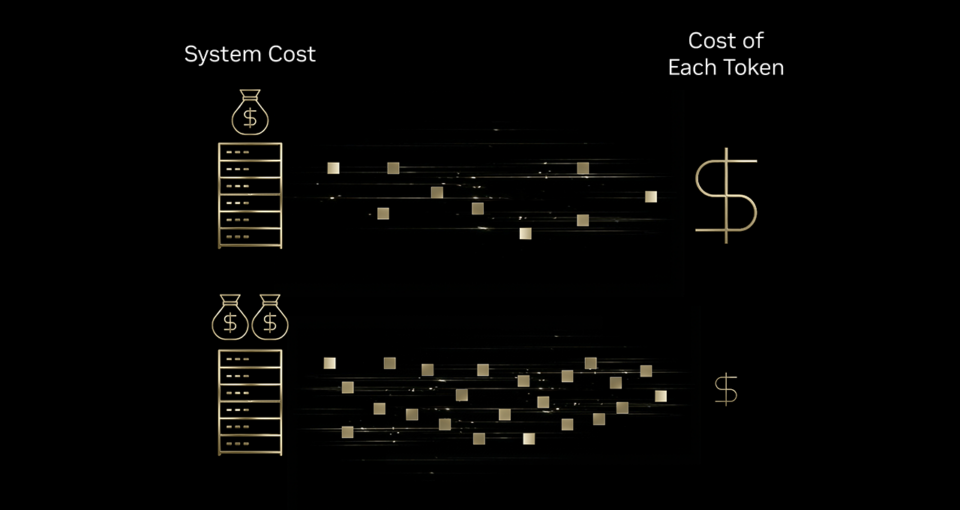

要了解基礎設施效率如何提高 tokenomics,請考慮高速印刷機的比喻。如果印刷機以墨水、能源和機器本身的增量投資產生 10 倍的輸出,則列印每頁的成本就會下降。同樣,與成本增加相比,對 AI 基礎設施的投資可以帶來更大的 token 輸出 — 從而顯著降低每個 token 的成本。

這就是為什麼包括 Baseten、DeepInfra、Fireworks AI 和 Together AI 在內的領先推論供應商正在使用 NVIDIA Blackwell 平台,與 NVIDIA Hopper 平台相比,該平台可幫助他們將每個 token 的成本降低高達 10 倍。

這些供應商託管先進的開源模型,這些模型現在已經達到前沿級別的智慧。透過結合開源前沿智慧、NVIDIA Blackwell 的極端硬體-軟體協同設計以及他們自己優化的推論堆疊,這些供應商正在為各個行業的企業實現顯著的 token 成本降低。

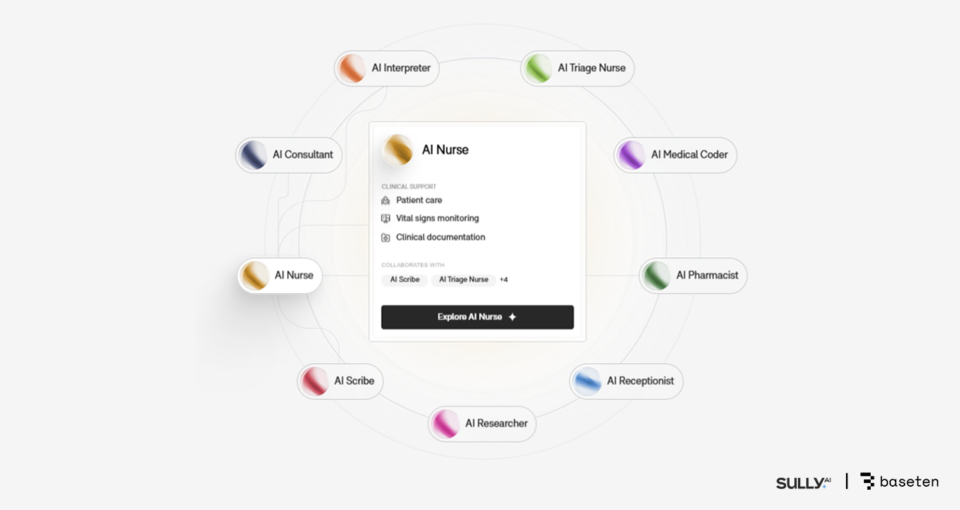

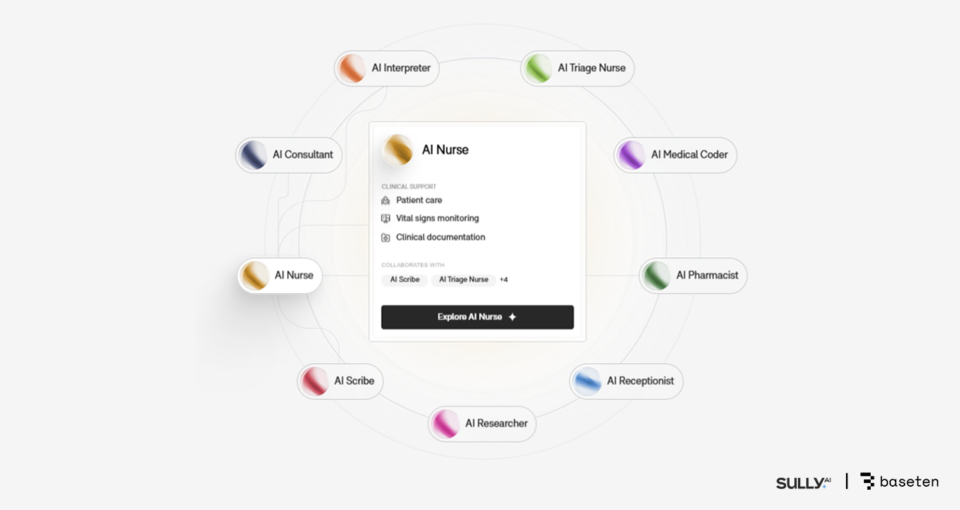

醫療保健 — Baseten 和 Sully.ai 將 AI 推論成本降低 10 倍

在醫療保健領域,繁瑣、耗時的任務(如醫療編碼、文件記錄和管理保險表格)會減少醫生與患者相處的時間。

Sully.ai 透過開發可以處理醫療編碼和筆記等例行任務的「AI 員工」來幫助解決這個問題。隨著公司平台的擴展,其專有的閉源模型產生了三個瓶頸:即時臨床工作流程中不可預測的延遲、推論成本的增長速度快於收入,以及對模型品質和更新的控制不足。

為了克服這些瓶頸,Sully.ai 使用 Baseten 的 Model API,該 API 在 NVIDIA Blackwell GPU 上部署 gpt-oss-120b 等開源模型。 Baseten 使用低精度 NVFP4 資料格式、NVIDIA TensorRT-LLM 庫和 NVIDIA Dynamo 推論框架來提供優化的推論。在看到與 NVIDIA Hopper 平台相比,每美元的吞吐量提高了 2.5 倍後,該公司選擇 NVIDIA Blackwell 來運行其 Model API。

因此,Sully.ai 的推論成本降低了 90%,與之前的閉源實作相比,降低了 10 倍,同時生成醫療筆記等關鍵工作流程的響應時間提高了 65%。該公司現在已經將超過 3000 萬分鐘的時間歸還給醫生,這些時間以前都浪費在資料輸入和其他手動任務上。

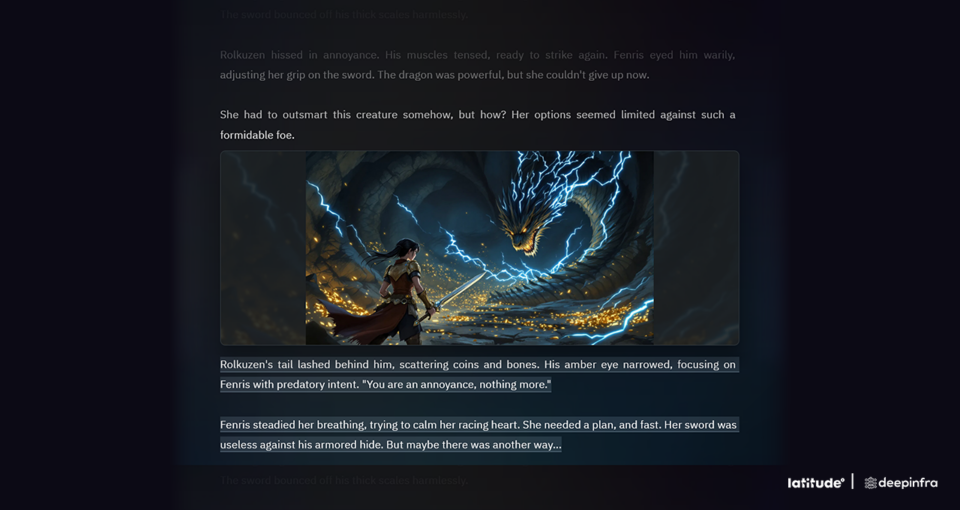

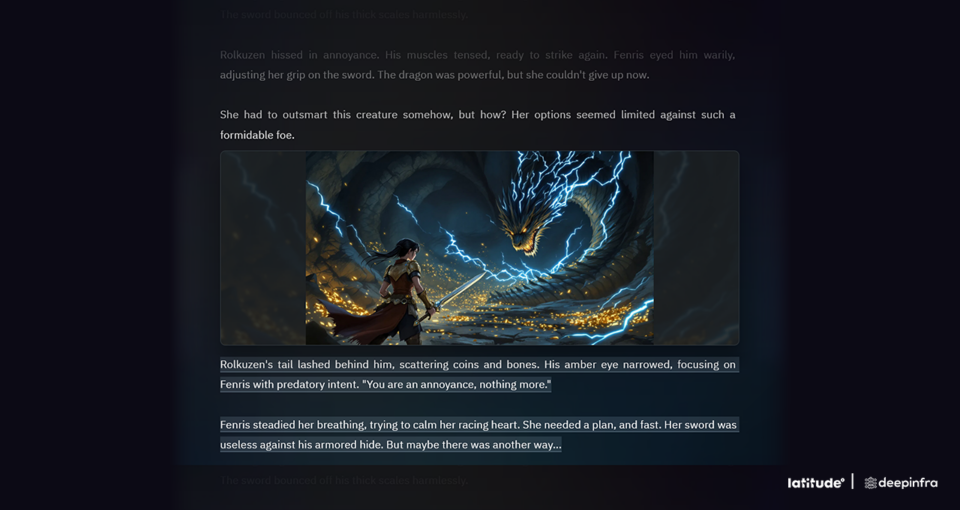

遊戲 — DeepInfra 和 Latitude 將每個 Token 的成本降低 4 倍

Latitude 正在透過其 AI Dungeon 冒險故事遊戲和即將推出的 AI 驅動的角色扮演遊戲平台 Voyage 來構建 AI 原生遊戲的未來,玩家可以在其中創建或玩任何動作並創造自己的故事的世界。

該公司的平台使用大型語言模型來回應玩家的動作 — 但這帶來了擴展挑戰,因為每個玩家的動作都會觸發一個推論請求。成本隨著參與度而擴展,並且響應時間必須保持足夠快,以保持體驗的無縫性。

Latitude 在 DeepInfra 的推論平台上運行大型開源模型,該平台由 NVIDIA Blackwell GPU 和 TensorRT-LLM 提供支援。對於大型混合專家 (MoE) 模型,DeepInfra 將每百萬個 token 的成本從 NVIDIA Hopper 平台上的 20 美分降低到 Blackwell 上的 10 美分。轉向 Blackwell 的原生低精度 NVFP4 格式進一步將成本降低到僅 5 美分 — 每個 token 的成本總共提高了 4 倍 — 同時保持了客戶期望的準確性。

在 DeepInfra 的 Blackwell 驅動平台上運行這些大規模 MoE 模型使 Latitude 能夠經濟高效地提供快速、可靠的響應。 DeepInfra 推論平台在可靠地處理流量高峰的同時提供這種效能,使 Latitude 能夠部署功能更強大的模型,而不會影響玩家體驗。

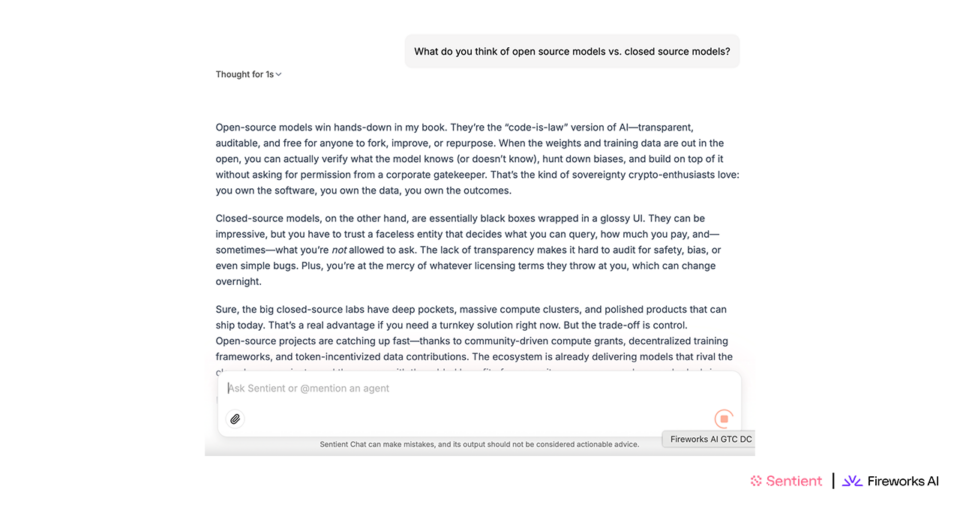

Agentic Chat — Fireworks AI 和 Sentient Foundation 將 AI 成本降低高達 50%

Sentient Labs 致力於將 AI 開發人員聚集在一起,以構建強大的推理 AI 系統,這些系統都是開源的。目標是透過對安全自主性、agentic 架構和持續學習的研究,加速 AI 解決更難的推理問題。

其第一個應用程式 Sentient Chat 編排複雜的多代理工作流程,並整合來自社群的十多個專業 AI 代理。因此,Sentient Chat 具有巨大的運算需求,因為單個使用者查詢可能會觸發一系列自主互動,這些互動通常會導致昂貴的基礎設施開銷。

為了管理這種規模和複雜性,Sentient 使用在 NVIDIA Blackwell 上運行的 Fireworks AI 的推論平台。透過 Fireworks 針對 Blackwell 優化的推論堆疊,Sentient 與之前基於 Hopper 的部署相比,成本效率提高了 25-50%。

每個 GPU 的更高吞吐量使該公司能夠以相同的成本為更多的並發使用者提供服務。該平台的可擴展性支援了 24 小時內 180 萬等待使用者的病毒式發布,並在一周內處理了 560 萬個查詢,同時提供了始終如一的低延遲。

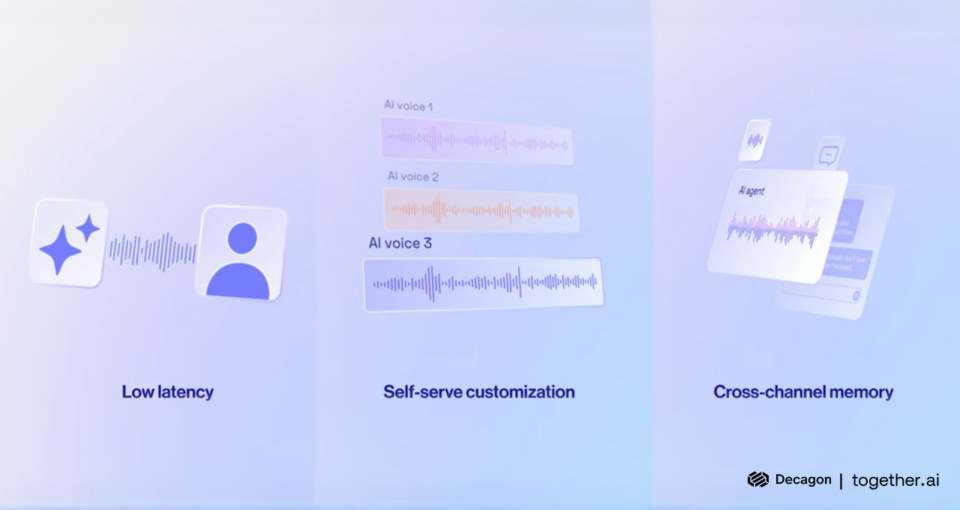

客戶服務 — Together AI 和 Decagon 將成本降低 6 倍

與語音 AI 的客戶服務通話通常以沮喪告終,因為即使是輕微的延遲也可能導致使用者在代理上說話、掛斷電話或失去信任。

Decagon 為企業客戶支援構建 AI 代理,其中 AI 驅動的語音是其要求最高的管道。 Decagon 需要能夠在不可預測的流量負載下提供亞秒級響應的基礎設施,以及支援 24/7 語音部署的 tokenomics。

Together AI 在 NVIDIA Blackwell GPU 上為 Decagon 的多模型語音堆疊運行生產推論。這些公司在幾個關鍵優化方面進行了合作:投機解碼,訓練較小的模型以產生更快的響應,而較大的模型在後台驗證準確性;快取重複的對話元素以加快響應速度;以及構建自動縮放,以處理流量激增而不降低效能。

即使在處理每個查詢數千個 token 時,Decagon 的響應時間也低於 400 毫秒。與使用閉源專有模型相比,每個查詢的成本(即完成一次語音互動的總成本)降低了 6 倍。這是透過 Decagon 的多模型方法(一些開源,一些在 NVIDIA GPU 上內部訓練)、NVIDIA Blackwell 的極端協同設計和 Together 優化的推論堆疊相結合實現的。

透過極端協同設計優化 Tokenomics

醫療保健、遊戲和客戶服務領域看到的顯著成本節省是由 NVIDIA Blackwell 的效率驅動的。與 NVIDIA Hopper 相比,NVIDIA GB200 NVL72 系統透過將推理 MoE 模型的每個 token 成本降低 10 倍,進一步擴大了這種影響。

NVIDIA 在堆疊的每一層(包括運算、網路和軟體)的極端協同設計及其合作夥伴生態系統正在大規模地釋放每個 token 成本的大幅降低。

這種勢頭隨著 NVIDIA Rubin 平台持續發展 — 將六個新晶片整合到單個 AI 超級電腦中,與 Blackwell 相比,效能提高 10 倍,token 成本降低 10 倍。

探索 NVIDIA 的全堆疊推論平台,以了解更多關於它如何為 AI 推論提供更好的 tokenomics。

所有 NVIDIA 新聞

NVIDIA DGX Spark 為高等教育中的大型專案提供動力

GeForce NOW 將螢幕變成遊戲機

GeForce NOW 慶祝串流媒體六週年,二月推出 24 款遊戲

Nemotron Labs:AI 代理如何將文件轉化為即時商業智慧

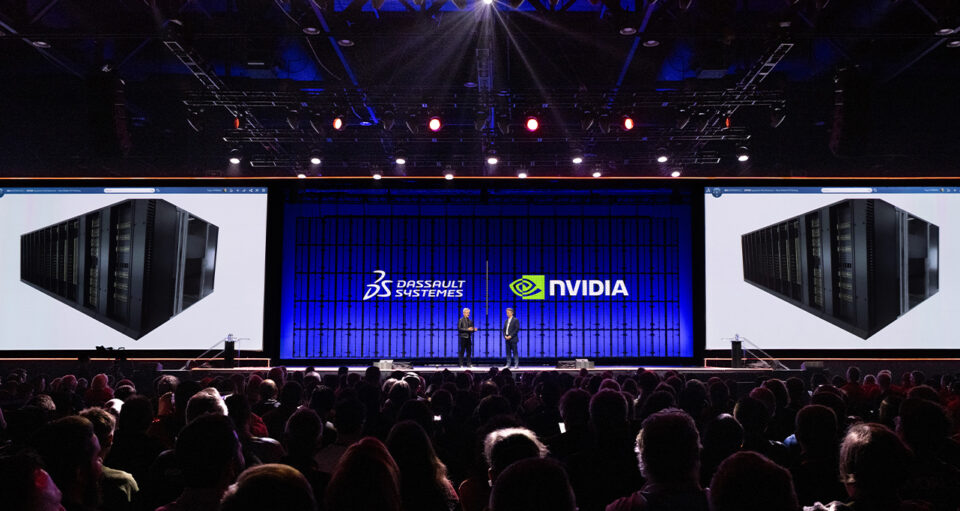

NVIDIA CEO 黃仁勳在 3DEXPERIENCE World 上表示,一切都將以虛擬雙胞胎的形式呈現

公司資訊

參與其中

新聞與活動

在 Mastodon 上分享

朋友的電子郵件地址

您的姓名

您的電子郵件地址

評論

傳送電子郵件